参照ビッグデータの80%が愚かであるとき、AIからの提示は賢いといえるか

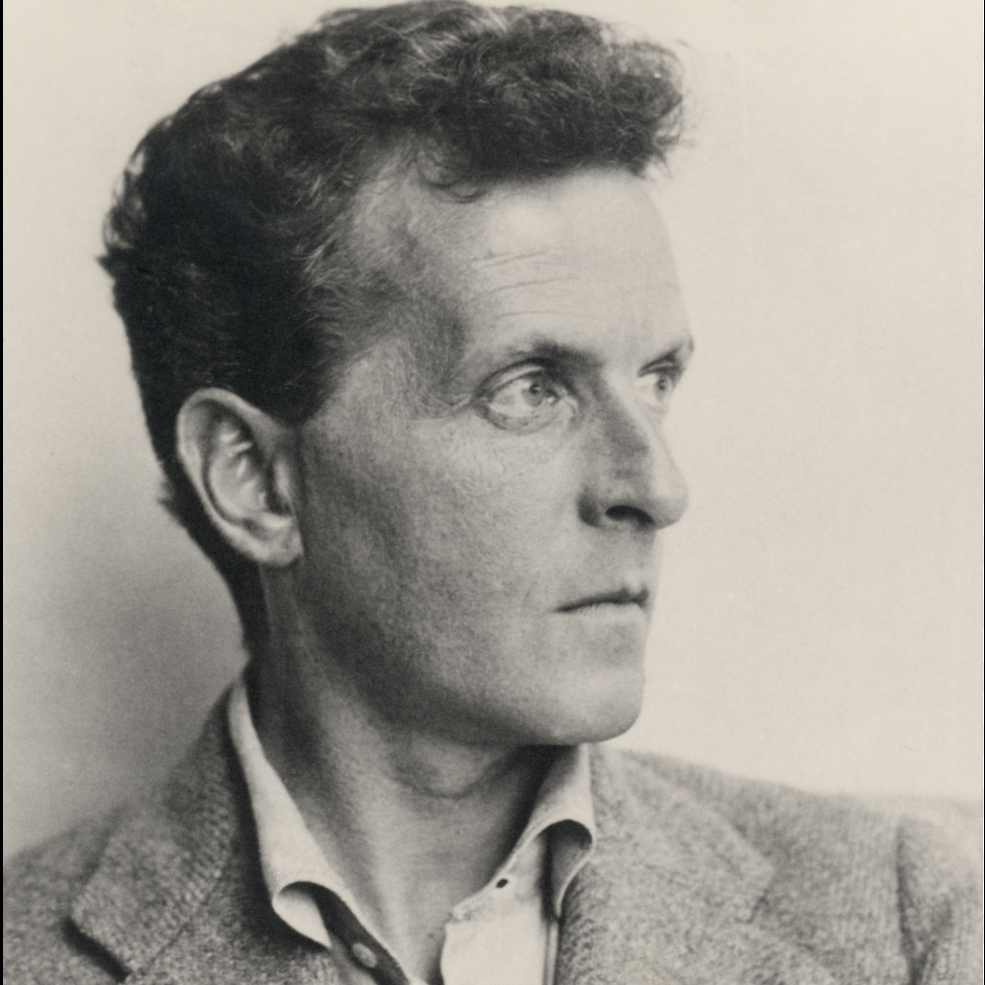

kaede

それの八割が愚かと言う判断の信憑性がそもそもどうか?と言う疑問も有る。

両方を使って、差異部分を追求すれば良くない?

pid

セナ

ある岩の重さを当てた人は100万円もらえる。

選りすぐりの地質学者3人が協議して推定した重さと群衆100人ぐらいが勘で出した答えを平均した重さはほとんど差がなかったらしい。

賢い、主観だが概ね正しい。と俺は思う。

クラマタ

言語理解的な部分での変な文法出力をするとか、一般常識の不足とかだったらそれは本当に愚かと言えるかもだけど

ぬらぺっちょ

AIの最適解だって現在では70〜80%程の精度だし、100%なっても愚かな参照元では自身の中の20%の賢さを抽出できない。

これはバカな人が自身の中にある真理に思考では気付け無いのと同じ。

思考でなくマグレで真理に気付くことはあるけどね。

つんつん

参照するデーターの80%が愚かであり残り20%は正論であろうAIからの掲示を、閲覧している人間がどれくらいの処理能力を有しているかに全てがある

なので答えは、賢いと断言する人もいれば、そうでないと言う人もいるだろう

結局のところ「わからん」が正解だ!

Yoo

AIはどう使うかが求められていて、不確かな情報を整理しても価値はないと思いますけど…

涼

質問の内容の深度に合わせて回答するタイプではあれば賢いと言える。

かぜ

ヒサ

具現化するのは、

人であり、

要は、一個人の、考え方による。

また、それを、学習させるのも、

人かもしれない。

もっとみる