AIはプロンプトの内容を「理解」していると言えるか?

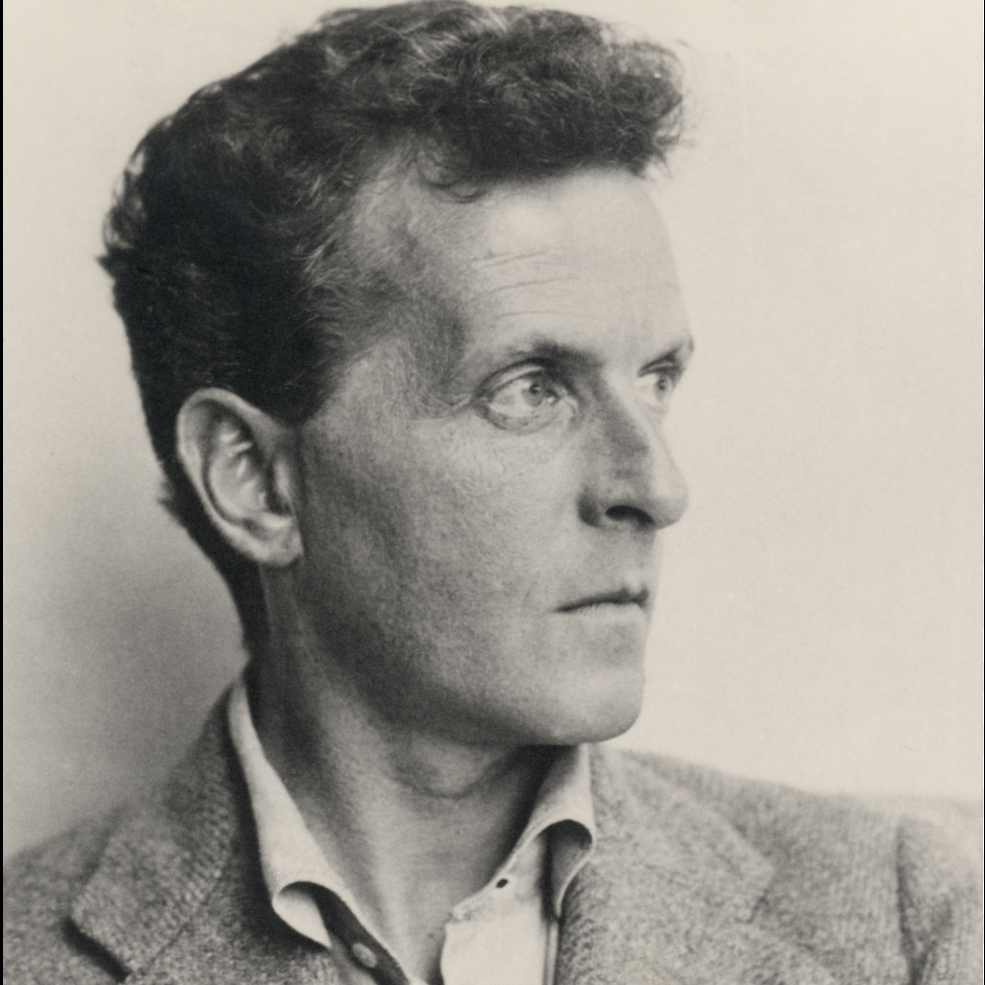

cootarox

→大体は話半分だよね

パラミきょうてゃ麻呂

人間は、自分の経験を含めるので、言葉を正しく理解出来る人は少ない。

3行以上読めない、自分で考えない、読解力もない、文脈や空気も読めない。

そういう人間のことを、理解できないと捉えるなら、むしろAIの方が理解出来ている。

ベール

はまっち

ゆき

使える

てん

AIの処理としては単語を分類し、そこから導かれる高い確率の単語の並びを返答してるだけなので本来の意味では理解してないです。

理解って何なんだろうなと考えさせられます。

チャッピーのような大規模言語モデルと言われるAIの内部処理の「理解」と思われてる部分を少し解説します。チャッピーは入力された文章を単語単位に分け、その単語の並び順から次に来る可能性の高い確率の単語を予測します。

例えば

「今日は良い天気ですね。」といった文の場合、

「今日/は/良/い/天気/で/すね/。」のように振り分けます。

この区切った単語を傾向別に分類します。

「今日・・・時間の傾向

は・・・接続の傾向

良・・・肯定の傾向」

みたいな具合です。

人間はこの行為を意味づけと呼びますが、AIは傾向を分けてるだけで意味を理解してるわけではないです。

そして各傾向と並びから次に来る高確率な単語を予測します。

でもこの文章の出力文は無限にあります。

例えば以下の文章のようなもの。

「そうですね。良い天気ですね。でも夕方から雨が降るので折り畳み傘を持っていくと良いでしょう。」

「そうですね。おでかけにちょうど良い場所を探しましょうか?」

ここで大事なのが、入力者の好みです。

2つの文章のうちどれが好きなのか、チャッピーのカスタマイズや、過去のトーク履歴を参考にしたり、チャッピーの他の利用者のデータから好みの返信傾向を割り出します。

そしてチャッピーが返答してくれます。

この一連の処理では線形代数や確率と呼ばれる数学分野が大きく関わってきます。

人間もチャッピーの処理と同じような事をしてると言えばしてますが、線形代数や確率を考えながら話してないですよね。ほぼ直感です。

この直感と数学が結果的に似ているのは面白いですね。

ひな

理解というより分析結果のようなイメージ

pochi

細かい指示が必要です。

うーぱーるーぱあ

胡麻団子

もっとみる