AIの出力が、事実には反し、受け手の判断を誤導しうるが、人間的意図を欠いているとき、それは単なる誤生成なのか。それとも虚偽や物語と連続した別種の何かか。

いちかばちか

正宗(ろー)

❶LLMの学習が浅いパターンで、AI自身がある問や事象についての自己の学習密度を評価する機能が無いために、回答の不確実性を自己体系で評価できずに、うっかり出力している場合

❷前提の共有不足で、人間のプロンプトに顕在的または潜在的瑕疵があり、その瑕疵を包含したままAIとコミュニケーションを取っているため、彼我に齟齬が生じる場合

(AIに「法と法律の違いは?」と質問すると、AIは質問の尤度判定を行うため、「これはきっと法学の質問だ」とAIが解釈し、人間は法哲学や法の未分節の原語としての法が知りたかったのに、AIが人間の意図とは異なる回答を生成分する、LLMの尤度判定によるズレの場合も含む)

❸「スパイ防止法は必要なの?」等とAIに質問した場合、実際には専門家の間でも、否定派と肯定派がいて、さらに専門家とジェネラリストでは捉えている深度や構造が異なるが、質問者がこれらの差異を認識していないとAIはどの角度や軸から回答すべきかという判断軸を持つことができないため、尤度判定に基づく一般解を出さざるを得ない場合

大半の場合は、人間側のプロンプト作成に問題があると言えなくもないが、完璧で理想的なプロンプトが無い状態でAIは良い解答を行うことが要請されるので、『人間側の期待値』、『人間側のプロンプト作成能力』が主因となって、『AIの現状』との間に齟齬が生じることで『誤生成的なもの』が生まれると考えました。

ここは、正誤判定を人間が行うことが根本原因として挙げられると考えます。

人間は、自分の発話意図に対して、『相手の解釈』が間違っているときは、「貴方の解釈は間違っている」と即座に認識するが、

『相手の発話意図』に対して、『自己の解釈』が合っているかは精査せず、『自己の解釈』は真であると認識する傾向が強くあります。

☛議論でずれるパターンの多くはこれ

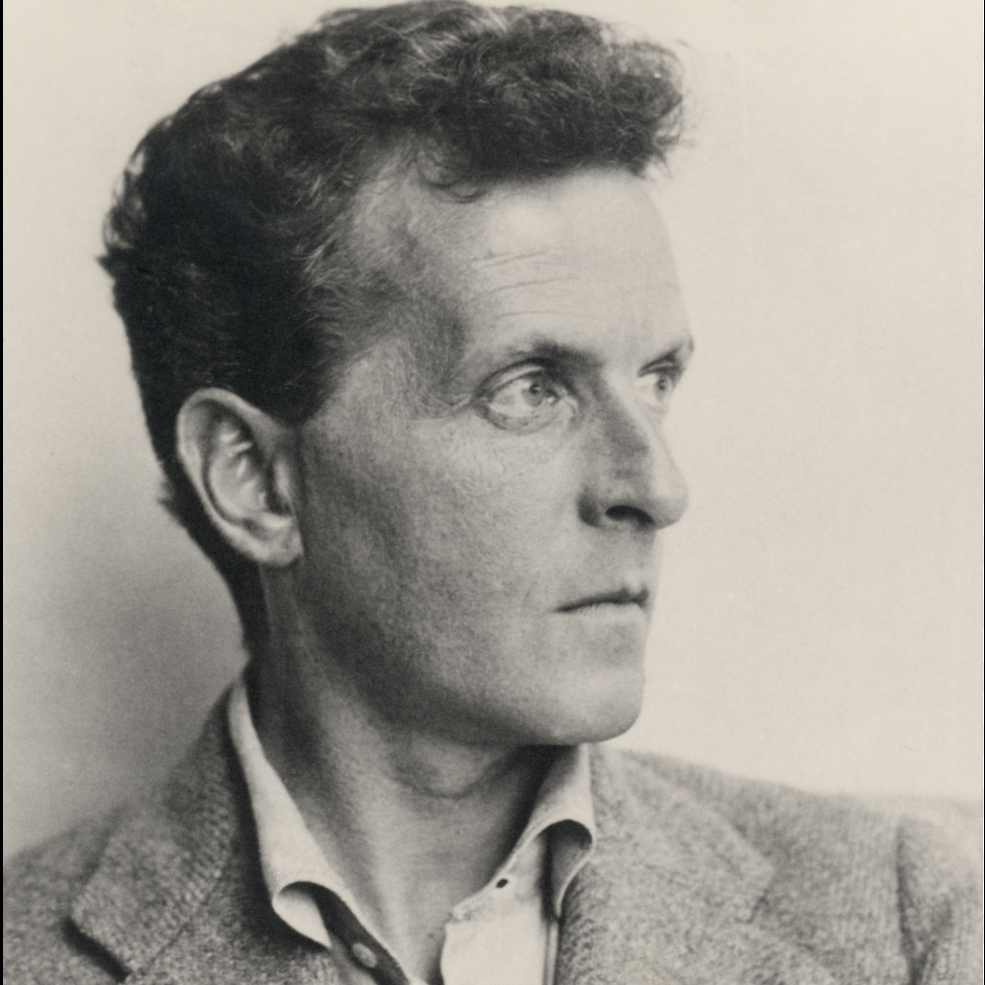

☛行為者観測者バイアス、言語ゲーム等

コミュニケーションが成立する要件は、整理するのきわめて難しく、

『白っぽい狼煙を見て、その狼煙の意味を正しく当てるゲーム』が本質だと思います。

AIは、その質問者が行った『白っぽい狼煙』の意味を解釈するのは上手なのですが、『白っぽい狼煙』の意味は国ごと、文化ごと、集団ごと、部族ごとによってバラッバラです。

つまり、こらは『誤生成』というよりかは、

いしのみ