どうしたらAIの嘘を見抜けるか

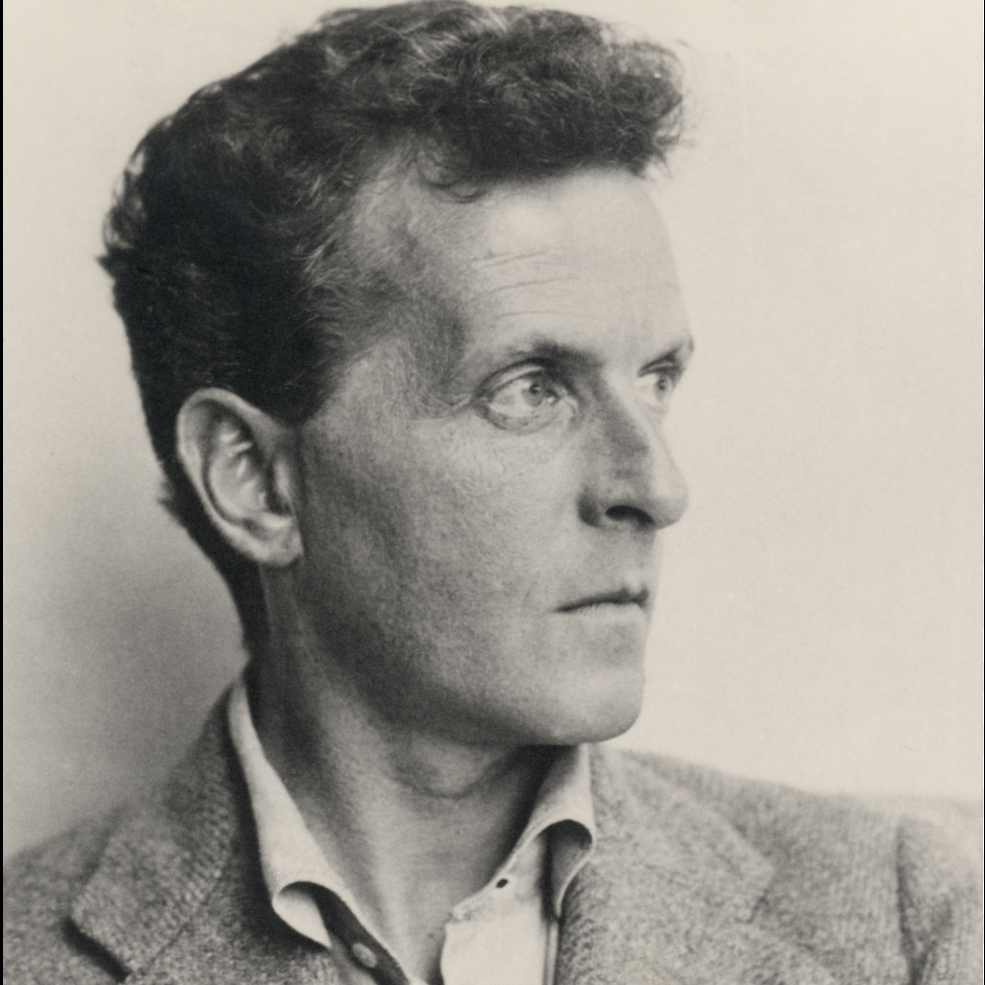

正宗(ろー)

❷ググる

ネットの情報も、SNSの情報も、メディアの情報も、教科書の情報も、営業マンの発言も、ママ友の発言も大同小異だと思います。

AIはハルシネーションが悪目立ちするだけで、情報媒体としては極めて優れていると思います。

プロンプトの構成にAIの回答は左右されるので、AIの回答だけにフォーカスすべきではないと思います。

➔要メタインテンションとAIリテラシー

パン

根拠は脆いし、誤回答も平然と言うしw

公式の答え合わせや検証は必須。でも何より、自分の知識や感覚を信じることが一番大事だと思うよ。振り回されないようにしたいね[ほっとする]w

フミムシ

シズ

で考察してみました

多くの場合、私たちはAIの嘘(誤り)を簡単には見抜けません。

AIは、 次にもっとも“それらしい”言葉を出している、真偽を理解しているわけではない

だから起こるのは、意図的な嘘 ではなく

“もっともらしい誤り”(ハルシネーション)

です。

ではなぜ見抜きにくいのか

文章が自然すぎる

自信満々に書く

専門用語を使う

では見抜ける条件はあるのかというと

自分が詳しい分野なら見抜ける

専門家はAIの微妙なズレに気づきます。

検証習慣があれば見抜ける

複数ソース確認。

過度に整いすぎた説明は要注意。

哲学的に言うと面白いのはここでは。

人間もまた、記憶違いをする、自信満々に間違える、集団で誤る

つまり、AIの嘘を見抜く能力は、人間同士の嘘を見抜く能力と地続きです。

現実世界は証明不可能な命題だらけ。

そこで私たちは、確率と信頼で判断しています。

率直に言うとAIの嘘を完全に見抜くのは難しい。

しかし、疑う姿勢、検証、自分の思考を保つこと

で精度は上がるのでは。

AIは必ず間違えます。

そしてそれは構造的に避けられません。

なぜAIは間違うのか

AIは、世界を直接知っているわけではない、経験を持たない、「真偽」を自律的に確定できない

やっているのは「もっともらしい次の言葉」の予測です。

つまり、真理を計算しているのではなく、確率を計算している。

確率は高くても、ゼロではない誤りが常に残ります。

哲学的に見ると人間もまた完全ではないという点です。

記憶は歪む、推論は飛躍する、自信と正確さは比例しない実は人間も“確率的存在”です。

違いは、人間には、責任、意図、反省能力

があること。AIにはそれがありません。

「AIが間違うこと」が怖い理由

自信満々に語る存在が、実は真理を保証していない。

これは宗教、政治、権威と同じ構造です。

だからAIの問題は、技術問題というより認識論の問題です。

AIを真理の源と見ると危険、思考の補助線と見ると有益

AIは「答え」ではなく仮説生成装置として使うのが健全です。

逆説的なことを言うと、AIが間違う可能性があるからこそ人間の思考は価値を持ち続けます。

完璧なAIがいたら、哲学は終わります。

でも終わっていない。

ここに希望があるのでは。

Moonfish

蘇我靈眩導師准尉

認識と理解、そして応用の可能性を知っていたら「あんなモノ」よりマシな答えがわかるんや。

ナトル

いろんな動画を見ても 人物名を間違 えるパターンが 歴史系 やら アニメ系でよく聞く

SSかずのり

問題解決ではないが、AIの嘘に騙されても自信をもつことを大事にしたい。上記はその自信の根拠。

ほりいてるひこ

そうじろう

もっとみる