人気

天斗

█▀█▄─▀█▄█▀─▄█▀█

█▀▄▀█──▀──█▀▄▀█

▀█▄▀█▐█▄█▌█▀▄█▀

▄─▀▀▀─▐█▌─▀▀▀─▄

██▌▄█▌███▐█▄▐██

██▌██▌▀▀▀▐██▐██

██▌██▀▀▀▀▀██▐██

▀▀─█▌▄███▄▐█─▀

Transformer Autobot

クワジ

名無し

にゃも氏

回答数 67>>

ver.SHIBA

ニルヴァーシュ💍

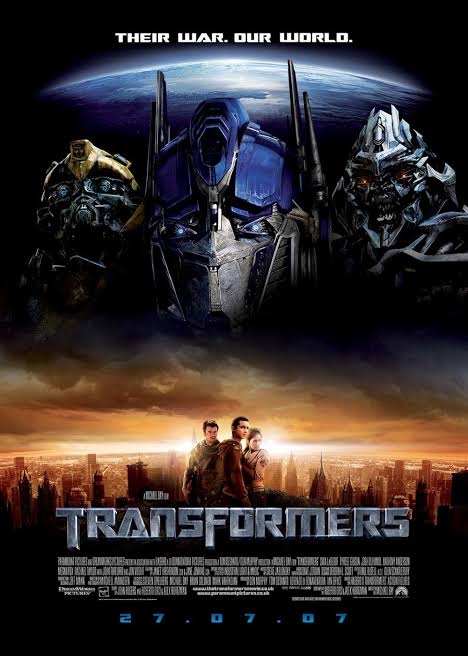

#トランスフォーマー

べーこん

もっとみる

関連検索ワード

新着

げら§エンペラー§

これは、70億パラメーターのオープンアクセスAIモデルであり、推論効率とメモリ効率を高めるためにTransformerとMamba2を組み合わせたハイブリッド構造を採用していることが特徴です。

Haruki

プロフィールを見てくれてありがとうございます。

文字数が足りないので、ここで詳しく自己紹介させてください。

🎓 【大学と専攻】

現在、イスラエル工科大学 (Technion) の中国キャンパス(GTIIT)で勉強しています。

専攻は バイオテクノロジー & 食品工学 (BFE) です🧬。

授業はすべて英語 (All English) なので、毎日レポートと格闘しています…💦

専門は生物(Wet)ですが、AIやデータ分析(Dry) も好きで、最近はTransformerなどのLLMモデルを研究している「二刀流」を目指しています💻。

🎧 【音楽沼】

日本の音楽が大好きで、それが日本語を学ぶきっかけです。

tayori / ヨルシカ (透明感のある曲が好きです)

MyGO!!!!! / RAS (Liveの熱気が最高!)

特に『描いた未来』のMVが好きで、聖地巡礼のために逗子海岸まで行きました🌊。(写真1枚目)

🍗 【実は…】

食品科学を学んでいますが、実はジャンクフードがやめられません😂

一番好きなのは とんかつ と KFC です!

普段はラボやPCの前に座りっぱなしなので、運動神経はゼロに近いです(笑)。

でも、海辺を散歩するのは大好きです🚶♂️。

🗣️ 【言語】

🇨🇳 Chinese: Native

🇬🇧 English: Fluent (Academic Level)

🇯🇵 Japanese: 勉強中!(Learning)

🌏 【将来の目標】

卒業後は、日本の大学院に進学するか、日本で就職したいと考えています。

そのために、今も研究と日本語を頑張っています!💪

日本の同世代の友達を作って、いろいろな話をしたいです。

おすすめの音楽や、美味しいお店を教えてくれると嬉しいです!

英語や中国語なら教えられるので、気軽にコメントやメッセージください📩

よろしくお願いします!

#大学生 #日常 #GRAVITY初心者 #tayori #日本語勉強中

ぽっぷこーん

G generative 生成

P pre-trained 学習済み

T transformer 文脈を捉える

みたいな意味らしいよ

グレー

あと数学は何を勉強しよっかな、関数解析は早すぎるかな。いけるかな。

誰かに数学布教する目的一点なら普通に代数とか離散数学、位相とか非ユークリッド幾何やった方がいいかなとは思うんですけどねえ

kiwi

「傷ついてもまた元に戻れる」と言われているような気がして。

TRANSFORMAR ~トランスフォーマー~

ひろ✨

代表的な生成モデルには、確率的生成モデル(Probabilistic Generative Models) と 深層生成モデル(Deep Generative Models) がある。前者には混合ガウスモデル(GMM)や隠れマルコフモデル(HMM)などが含まれるが、近年主流となっているのは後者であり、ニューラルネットワークによる高次元分布の近似を行う。特に有名なのが、変分オートエンコーダ(VAE)、敵対的生成ネットワーク(GAN)、および**拡散モデル(Diffusion Model)**である。

VAEはエンコーダ・デコーダ構造を持ち、潜在空間における確率的表現学習を行う。GANはジェネレータとディスクリミネータの**ミニマックス最適化(minimax optimization)**によって、分布近似を競合的に洗練させる。一方、Diffusion Modelはノイズ除去過程を逐次的に学習し、高品質なサンプル生成を可能にする。この拡散モデル系は、**スコアベース生成(Score-based Generation)**とも呼ばれ、現在の画像生成(例:Stable Diffusion、DALL·E、Midjourney)や動画生成の中心技術となっている。

また、自然言語領域では、自己回帰型言語モデル(Autoregressive Language Model)が主流であり、Transformerアーキテクチャを基盤とする。GPTやLLaMAなどは、トークン列の条件付き確率 P(x_t|x_{<t}) を逐次推定し、テキストを生成する。これにより、文脈保持・推論・スタイル模倣などの高次言語生成能力が実現している。

さらに近年では、マルチモーダル統合(text-to-image, text-to-video, text-to-audioなど)が進み、生成系AIは単一モーダルの枠を超えて「統合的創発(emergent multimodality)」を示すに至った。これは巨大パラメータ空間と自己教師あり学習(self-supervised learning)による**表現学習の汎化(representation generalization)**の成果であり、人間の創造的活動の一部を模倣・拡張する段階に入っている。

要するに生成系AIとは、確率的表現学習・深層分布近似・モーダル統合によって新たなデータを創出する人工知能技術体系であり、単なる情報処理を超え、創造の自動化を実現する計算的パラダイムである。

もっとみる

おすすめのクリエーター

ぽっぷこーん

※投稿はフィクションです

28歳/繊細真面目ひょうきん

優しい世界に生きてる。

ライオンズファンとパドレスファンとメタラーパンクロッカー、増えろ!

スペイン語と英語勉強してる。

ノーベル平和賞欲しい。

一人の人間に可能なことは万人にも可能だと私は信じている—ガンディー

フォロワー

0

投稿数

11190

べーこん

東京住み、愛知出身、バイク乗りの温泉好き社内SE

フォロワー

0

投稿数

3559

kiwi

80〜90年代のロボットアニメ・玩具・プラモデルが好きです

レトロゲームもたまにやります

フォロワー

0

投稿数

3239

ひろ✨

32、哲学、恋愛、就職・転職、お笑い政治経済、🇺🇸🇯🇵ドル円、Java、英語、法律、AI、ディープラーニングG検定、メンタルヘルス、基本情報、うつ病、愛知、名言、政策金利

フォロワー

0

投稿数

2213

げら§エンペラー§

食べること温泉、旅行大好きです。

旅行仲間募集中!

グルチャでは小さな情報を共有したり情報交換の場にしてます。

株仲間ほしい。

嫁募集42才まで。

グルメ、旅行、おしゃべりで明るい子が良いなぁ❗

#投資仲間

#旅友

#婚活

#50代

#グルメ

フォロワー

0

投稿数

642

関連ハッシュタグ

zuubo

コミコン限定デバスター

日本版もあったけど同じ値段だったからこっちにした。

後から日本版は頭部のバイザーと両目入れ替え方式でどっちも再現出来ると知った・・・

#トランスフォーマー

#Transformers

zuubo

ハズブロクラウドファンディング

ゴッドファイヤーコンボイ

検品した都合でいきなり最終形態のゴッドファイヤーコンボイwithマトリクスソード

#トランスフォーマー

#Transformers

#ゴッドファイヤーコンボイ

NeonTonez

トランスフォーマーのミラージュはかっこいい[ほほえむ]

#トランスフォーマー #transformers

Aoi

#TRANSFORMERS #洋画

久しぶりにトランスフォーマーを。

、、ときめき止まらない。[惑星]

好きな人いますかー?

ちなみにこのシリーズで好きな作品は?

Sparerib

yolopark amk pro メガトロン

海外からなんかきたと思ったら、ヨロパークだった。

海外輸入なんで心配でしたが、モーマンタイでした。

いやぁこれは凄いですよ。

オプティマスプライムも欲しくなるなぁ。

まだ参考展示なんですけどね。

#トランスフォーマー

#TRANSFORMERS

Sparerib

アルマダコンボイが1万で売ってたので購入。

正直全く知らないんですけど、見た目が好みすぎました。

いつか作品も見てみたいですd('∀'*)

#トランスフォーマー

#TRANSFORMERS